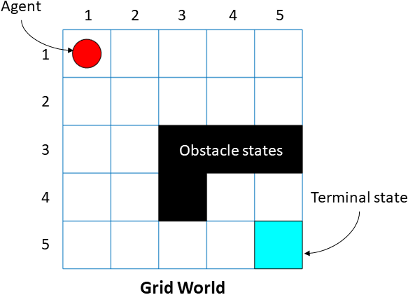

Мир сетки является двумерной, основанной на ячейке средой, где агент начинает с одной ячейки и двигает терминальную ячейку при сборе как можно большего количества вознаграждения. Среды мира сетки полезны для применения алгоритмов обучения с подкреплением, чтобы обнаружить, что оптимальные пути и политики для агентов на сетке добираются до своей терминальной цели в наименьшем количестве количества перемещений.

Reinforcement Learning Toolbox™ позволяет вам создать пользовательские среды мира сетки MATLAB® для своих собственных приложений. Создать пользовательскую среду мира сетки:

Создайте модель мира сетки.

Сконфигурируйте модель мира сетки.

Используйте модель мира сетки, чтобы создать вашу собственную среду мира сетки.

Можно создать собственную модель мира сетки с помощью createGridWorld функция. Задайте размер сетки при создании GridWorld объект модели.

GridWorld объект имеет следующие свойства:

| Свойство | Только для чтения | Описание | ||

|---|---|---|---|---|

GridSize | Да | Размерности мира сетки, отображенного как | ||

CurrentState | Нет | Имя текущего состояния агента, заданного как строка. Можно использовать это свойство установить начальное состояние агента. Агент всегда начинает с Агент начинает с | ||

States | Да | Вектор строки, содержащий имена состояния мира сетки. Например, для модели | ||

Actions | Да | Вектор строки, содержащий список возможных действий, которые может использовать агент. Можно установить действие, когда вы создаете модель мира сетки при помощи GW = createGridWorld(m,n,moves) Задайте

| ||

T | Нет | Матрица переходов, заданная как трехмерный массив.

Например, рассмотрите детерминированный объект northStateTransition = GW.T(:,:,1)

От вышеупомянутой фигуры, значения | ||

R | Нет | Вознаградите матрицу перехода, заданную как трехмерный массив. Вознаградите матрицу перехода Настройте | ||

ObstacleStates | Нет |

Черные ячейки являются состояниями препятствия, и можно задать их: GW.ObstacleStates = ["[3,3]";"[3,4]";"[3,5]";"[4,3]"]; Для примера рабочего процесса смотрите, Обучают Агента Обучения с подкреплением в Основном Мире Сетки. | ||

TerminalStates | Нет |

GW.TerminalStates = "[5,5]"; Для примера рабочего процесса смотрите, Обучают Агента Обучения с подкреплением в Основном Мире Сетки. |

Можно создать среду марковского процесса принятия решений (MDP) с помощью rlMDPEnv из модели мира сетки от предыдущего шага. MDP является дискретным временем стохастический процесс управления. Это служит математической основой для моделирования принятия решения в ситуациях, где результаты частично случайны и частично под управлением лица, принимающего решения. Агент использует объект rlMDPEnv среды мира сетки взаимодействовать с объектом модели мира сетки GridWorld.

Для получения дополнительной информации смотрите rlMDPEnv и обучите агента обучения с подкреплением в основном мире сетки.

createGridWorld | rlMDPEnv | rlPredefinedEnv