Ошибка классификации

L = loss(tree,TBL,ResponseVarName)tree классифицирует данные на TBL, когда TBL.ResponseVarName содержит истинные классификации.

При вычислении потери, loss нормирует вероятности класса в Y к вероятностям класса, используемым для обучения, сохраненного в Prior свойство tree.

L = loss(___,Name,Value)Name,Value парные аргументы, с помощью любого из предыдущих синтаксисов. Например, можно задать веса наблюдения или функция потерь.

tree — Обученное дерево классификацииClassificationTree объект модели | CompactClassificationTree объект моделиОбученное дерево классификации в виде ClassificationTree или CompactClassificationTree объект модели. Таким образом, tree обученная модель классификации, возвращенная fitctree или compact.

TBL — Выборочные данныеВыборочные данные в виде таблицы. Каждая строка TBL соответствует одному наблюдению, и каждый столбец соответствует одному переменному предиктору. Опционально, TBL может содержать дополнительные столбцы для весов наблюдения и переменной отклика. TBL должен содержать все предикторы, используемые, чтобы обучить tree. Многостолбцовые переменные и массивы ячеек кроме массивов ячеек из символьных векторов не позволены.

Если TBL содержит переменную отклика, используемую, чтобы обучить tree, затем вы не должны задавать ResponseVarName или Y.

Если вы обучаете tree использование выборочных данных содержится в table, затем входные данные для этого метода должны также быть в таблице.

Типы данных: table

X — Данные, чтобы классифицироватьДанные, чтобы классифицировать в виде числовой матрицы. Каждая строка X представляет одно наблюдение, и каждый столбец представляет один предиктор. X должен иметь одинаковое число столбцов, когда данные раньше обучали treeX должен иметь одинаковое число строк как число элементов в Y.

Типы данных: single | double

ResponseVarName — Имя переменной откликаTBLИмя переменной отклика в виде имени переменной в TBL. Если TBL содержит переменную отклика, используемую, чтобы обучить tree, затем вы не должны задавать ResponseVarName.

Если вы задаете ResponseVarName, затем необходимо сделать так как вектор символов или строковый скаляр. Например, если переменная отклика хранится как TBL.Response, затем задайте его как 'Response'. В противном случае программное обеспечение обрабатывает все столбцы TBL, включая TBL.ResponseVarName, как предикторы.

Переменная отклика должна быть категориальным, символом, или массивом строк, логическим или числовым вектором или массивом ячеек из символьных векторов. Если переменная отклика является символьным массивом, то каждый элемент должен соответствовать одной строке массива.

Типы данных: char | string

Y — Метки классаКласс помечает в виде категориального, символа, или массива строк, логического или числового вектора или массива ячеек из символьных векторов. Y должен иметь тот же тип, как классификация раньше обучала tree, и его число элементов должно равняться количеству строк X.

Типы данных: categorical | char | string | logical | single | double | cell

Задайте дополнительные разделенные запятой пары Name,Value аргументы. Name имя аргумента и Value соответствующее значение. Name должен появиться в кавычках. Вы можете задать несколько аргументов в виде пар имен и значений в любом порядке, например: Name1, Value1, ..., NameN, ValueN.

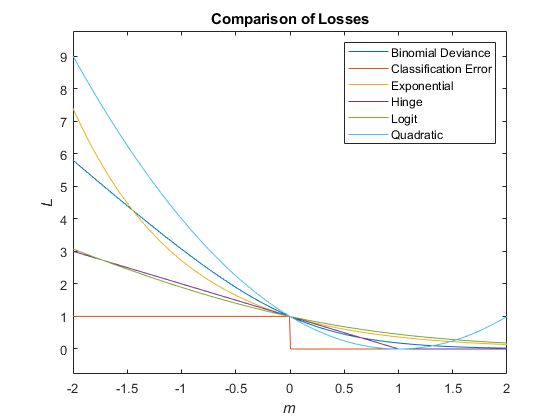

'LossFun' — Функция потерь'mincost' (значение по умолчанию) | 'binodeviance' | 'classiferror' | 'exponential' | 'hinge' | 'logit' | 'quadratic' | указатель на функциюФункция потерь в виде разделенной запятой пары, состоящей из 'LossFun' и встроенное имя функции потерь или указатель на функцию.

В следующей таблице перечислены доступные функции потерь. Задайте тот с помощью его соответствующего вектора символов или строкового скаляра.

| Значение | Описание |

|---|---|

'binodeviance' | Биномиальное отклонение |

'classiferror' | Неправильно классифицированный уровень в десятичном числе |

'exponential' | Экспоненциальная потеря |

'hinge' | Потеря стержня |

'logit' | Логистическая потеря |

'mincost' | Минимальный ожидал стоимость misclassification (для классификационных оценок, которые являются апостериорными вероятностями), |

'quadratic' | Квадратичная потеря |

'mincost' подходит для классификационных оценок, которые являются апостериорными вероятностями. Деревья классификации возвращают апостериорные вероятности как классификационные оценки по умолчанию (см. predict).

Задайте свою собственную функцию с помощью обозначения указателя на функцию.

Предположим тот n будьте количеством наблюдений в X и K будьте количеством отличных классов (numel(tree.ClassNames)). Ваша функция должна иметь эту подпись

lossvalue = lossfun(C,S,W,Cost)Выходной аргумент lossvalue скаляр.

Вы выбираете имя функции (lossfun).

C n- K логическая матрица со строками, указывающими, которые классифицируют соответствующее наблюдение, принадлежит. Порядок следования столбцов соответствует порядку класса в tree.ClassNames.

Создайте C установкой C(p,q) = 1 если наблюдение p находится в классе q, для каждой строки. Установите все другие элементы строки p к 0.

S n- K числовая матрица классификационных оценок. Порядок следования столбцов соответствует порядку класса в tree.ClassNamesS матрица классификационных оценок, похожих на выход predict.

W n- 1 числовой вектор из весов наблюдения. Если вы передаете W, программное обеспечение нормирует их, чтобы суммировать к 1.

Cost K-by-K числовая матрица затрат misclassification. Например, Cost = ones(K) - eye(K) задает стоимость 0 для правильной классификации и 1 для misclassification.

Задайте свое использование функции 'LossFun', @.lossfun

Для получения дополнительной информации о функциях потерь смотрите Потерю Классификации.

Типы данных: char | string | function_handle

'Weights' — Веса наблюденияones(size(X,1),1) (значение по умолчанию) | имя переменной в TBL | числовой вектор из положительных значенийВеса наблюдения в виде разделенной запятой пары, состоящей из 'Weights' и числовой вектор из положительных значений или имя переменной в TBL.

Если вы задаете Weights как числовой вектор, затем размер Weights должно быть равно количеству строк в X или TBL.

Если вы задаете Weights как имя переменной в TBL, необходимо сделать так как вектор символов или строковый скаляр. Например, если веса хранятся как TBL.W, затем задайте его как 'W'. В противном случае программное обеспечение обрабатывает все столбцы TBL, включая TBL.W, как предикторы.

loss нормирует веса так, чтобы веса наблюдения в каждом классе суммировали к априорной вероятности того класса. Когда вы предоставляете Weights, loss вычисляет взвешенную потерю классификации.

Типы данных: single | double | char | string

Name,Value аргументы сопоставили с сокращением поддеревьев:

'Subtrees' — Сокращение уровня'all'Сокращение уровня в виде разделенной запятой пары, состоящей из 'Subtrees' и вектор из неотрицательных целых чисел в порядке возрастания или 'all'.

Если вы задаете вектор, то всеми элементами должен быть, по крайней мере, 0 и в большей части max(tree.PruneList). 0 указывает на полное, несокращенное дерево и max(tree.PruneList) указывает на полностью сокращенное дерево (i.e., только корневой узел).

Если вы задаете 'all'то loss работает со всеми поддеревьями (т.е. целая последовательность сокращения). Эта спецификация эквивалентна использованию 0:max(tree.PruneList).

loss чернослив tree к каждому уровню, обозначенному в Subtrees, и затем оценивает соответствующие выходные аргументы. Размер Subtrees определяет размер некоторых выходных аргументов.

Вызвать Subtrees, свойства PruneList и PruneAlpha из tree mustBeNonempty. Другими словами, вырастите tree установкой 'Prune','on', или путем сокращения tree использование prune.

Пример: 'Subtrees','all'

Типы данных: single | double | char | string

'TreeSize' — Древовидный размер'se' (значение по умолчанию) | 'min'Древовидный размер в виде разделенной запятой пары, состоящей из 'TreeSize' и одно из следующих значений:

'se' — loss возвращает самый высокий уровень сокращения с потерей в одном стандартном отклонении минимума (L+se, где L и se относитесь к наименьшему значению в Subtrees).

'min' — loss возвращает элемент Subtrees с самой маленькой потерей, обычно самый маленький элемент Subtrees.

L — Потеря классификацииПотеря классификации, возвращенная как вектор длина Subtrees. Значение ошибки зависит от значений в Weights и LossFun.

se — Стандартная погрешность потериСтандартная погрешность потери, возвращенной как вектор длина Subtrees.

NLeaf — Количество вершинКоличество листов (терминальные узлы) в сокращенных поддеревьях, возвращенных как вектор длина Subtrees.

bestlevel — Лучше всего сокращение уровняЛучше всего сокращая уровень, как задано в TreeSize пара "имя-значение", возвращенная как скаляр, значение которого зависит от TreeSize:

TreeSize = 'se' — loss возвращает самый высокий уровень сокращения с потерей в одном стандартном отклонении минимума (L+se, где L и se относитесь к наименьшему значению в Subtrees).

TreeSize = 'min' — loss возвращает элемент Subtrees с самой маленькой потерей, обычно самый маленький элемент Subtrees.

По умолчанию, bestlevel уровень сокращения, который дает потерю в одном стандартном отклонении минимальной потери.

Вычислите повторно подставленную ошибку классификации для ionosphere набор данных.

load ionosphere

tree = fitctree(X,Y);

L = loss(tree,X,Y)L = 0.0114

Несокращенные деревья решений имеют тенденцию сверхсоответствовать. Один способ сбалансировать сложность модели и эффективность из выборки состоит в том, чтобы сократить дерево (или ограничить его рост) так, чтобы эффективность из выборки и в выборке была удовлетворительной.

Загрузите ирисовый набор данных Фишера. Разделите данные в обучение (50%) и валидацию (50%-е) наборы.

load fisheriris n = size(meas,1); rng(1) % For reproducibility idxTrn = false(n,1); idxTrn(randsample(n,round(0.5*n))) = true; % Training set logical indices idxVal = idxTrn == false; % Validation set logical indices

Вырастите дерево классификации использование набора обучающих данных.

Mdl = fitctree(meas(idxTrn,:),species(idxTrn));

Просмотрите дерево классификации.

view(Mdl,'Mode','graph');

Дерево классификации имеет четыре уровня сокращения. Уровень 0 является полным, несокращенным деревом (как отображено). Уровень 3 является только корневым узлом (i.e., никакие разделения).

Исследуйте ошибку классификации обучающих выборок на каждое поддерево (или уровень сокращения), исключая высший уровень.

m = max(Mdl.PruneList) - 1;

trnLoss = resubLoss(Mdl,'SubTrees',0:m)trnLoss = 3×1

0.0267

0.0533

0.3067

Полное, несокращенное дерево неправильно классифицирует приблизительно 2,7% учебных наблюдений.

Дерево, сокращенное к уровню 1, неправильно классифицирует приблизительно 5,3% учебных наблюдений.

Дерево сокращено к уровню 2 (i.e., пень), неправильно классифицирует приблизительно 30,6% учебных наблюдений.

Исследуйте ошибку классификации выборок валидации на каждом уровне, исключая высший уровень.

valLoss = loss(Mdl,meas(idxVal,:),species(idxVal),'SubTrees',0:m)valLoss = 3×1

0.0369

0.0237

0.3067

Полное, несокращенное дерево неправильно классифицирует приблизительно 3,7% наблюдений валидации.

Дерево, сокращенное к уровню 1, неправильно классифицирует приблизительно 2,4% наблюдений валидации.

Дерево сокращено к уровню 2 (i.e., пень), неправильно классифицирует приблизительно 30,7% наблюдений валидации.

Чтобы сбалансировать сложность модели и эффективность из выборки, считайте сокращение Mdl к уровню 1.

pruneMdl = prune(Mdl,'Level',1); view(pruneMdl,'Mode','graph')

Функции Classification loss измеряют прогнозирующую погрешность моделей классификации. Когда вы сравниваете тот же тип потери среди многих моделей, более низкая потеря указывает на лучшую прогнозную модель.

Рассмотрите следующий сценарий.

L является средневзвешенной потерей классификации.

n является объемом выборки.

Для бинарной классификации:

yj является наблюдаемой меткой класса. Программные коды это как –1 или 1, указывая на отрицательный или положительный класс (или первый или второй класс в ClassNames свойство), соответственно.

f (Xj) является классификационной оценкой положительного класса для наблюдения (строка) j данных о предикторе X.

mj = yj f (Xj) является классификационной оценкой для классификации наблюдения j в класс, соответствующий yj. Положительные значения mj указывают на правильную классификацию и не способствуют очень средней потере. Отрицательные величины mj указывают на неправильную классификацию и значительно способствуют средней потере.

Для алгоритмов, которые поддерживают классификацию мультиклассов (то есть, K ≥ 3):

yj* является вектором из K – 1 нуль, с 1 в положении, соответствующем истинному, наблюдаемому классу yj. Например, если истинный класс второго наблюдения является третьим классом и K = 4, то y 2* = [0 0 1 0] ′. Порядок классов соответствует порядку в ClassNames свойство входной модели.

f (Xj) является длиной вектор K из музыки класса к наблюдению j данных о предикторе X. Порядок баллов соответствует порядку классов в ClassNames свойство входной модели.

mj = yj* ′ f (Xj). Поэтому mj является скалярной классификационной оценкой, которую модель предсказывает для истинного, наблюдаемого класса.

Весом для наблюдения j является wj. Программное обеспечение нормирует веса наблюдения так, чтобы они суммировали к соответствующей предшествующей вероятности класса. Программное обеспечение также нормирует априорные вероятности, таким образом, они суммируют к 1. Поэтому

Учитывая этот сценарий, следующая таблица описывает поддерживаемые функции потерь, которые можно задать при помощи 'LossFun' аргумент пары "имя-значение".

| Функция потерь | Значение LossFun | Уравнение |

|---|---|---|

| Биномиальное отклонение | 'binodeviance' | |

| Неправильно классифицированный уровень в десятичном числе | 'classiferror' | метка класса, соответствующая классу с максимальным счетом. I {·} является функцией индикатора. |

| Потеря перекрестной энтропии | 'crossentropy' |

Взвешенная потеря перекрестной энтропии где веса нормированы, чтобы суммировать к n вместо 1. |

| Экспоненциальная потеря | 'exponential' | |

| Потеря стержня | 'hinge' | |

| Потеря логита | 'logit' | |

| Минимальный ожидал стоимость misclassification | 'mincost' |

Программное обеспечение вычисляет взвешенную минимальную ожидаемую стоимость классификации с помощью этой процедуры для наблюдений j = 1..., n.

Взвешенное среднее минимального ожидало, что потеря стоимости misclassification Если вы используете матрицу стоимости по умолчанию (чье значение элемента 0 для правильной классификации и 1 для неправильной классификации), то |

| Квадратичная потеря | 'quadratic' |

Этот рисунок сравнивает функции потерь (кроме 'crossentropy' и 'mincost') по счету m для одного наблюдения. Некоторые функции нормированы, чтобы пройти через точку (0,1).

Истинная стоимость misclassification является стоимостью классификации наблюдения в неправильный класс.

Можно установить истинную стоимость misclassification в классе при помощи 'Cost' аргумент значения имени, когда вы создаете классификатор. Cost(i,j) стоимость классификации наблюдения в класс j когда его истинным классом является i. По умолчанию, Cost(i,j)=1 если i~=j, и Cost(i,j)=0 если i=j. Другими словами, стоимостью является 0 для правильной классификации и 1 для неправильной классификации.

Ожидаемая стоимость misclassification на наблюдение является усредненной стоимостью классификации наблюдения в каждый класс.

Предположим, что у вас есть Nobs наблюдения, что вы хотите классифицировать с обученным классификатором, и у вас есть K классы. Вы помещаете наблюдения в матричный X с одним наблюдением на строку.

Ожидаемая матрица стоимости CE имеет размер Nobs- K. Каждая строка CE содержит ожидаемую (среднюю) стоимость классификации наблюдения в каждый K классы. CE(n,k)

где:

K является количеством классов.

апостериорная вероятность класса i для наблюдения X (n).

истинная misclassification стоимость классификации наблюдения как k, когда его истинным классом является i.

Для деревьев score классификации вершины является апостериорной вероятностью классификации в том узле. Апостериорная вероятность классификации в узле является количеством обучающих последовательностей, которые приводят к тому узлу с классификацией, разделенной на количество обучающих последовательностей, которые приводят к тому узлу.

Например, считайте классификацию предиктора X как true когда X< 0.15 или X> 0.95 , и X является ложным в противном случае.

Сгенерируйте 100 случайных точек и классифицируйте их:

rng(0,'twister') % for reproducibility X = rand(100,1); Y = (abs(X - .55) > .4); tree = fitctree(X,Y); view(tree,'Mode','Graph')

Сократите дерево:

tree1 = prune(tree,'Level',1); view(tree1,'Mode','Graph')

Сокращенное дерево правильно классифицирует наблюдения, которые меньше 0.15 как true. Это также правильно классифицирует наблюдения от.15 до.94 как false. Однако это неправильно классифицирует наблюдения, которые больше.94 как false. Поэтому счет к наблюдениям, которые больше.15, должен быть о.05/.85 =. 06 для true, и о.8/.85 =. 94 для false.

Вычислите музыку предсказания к первым 10 строкам X:

[~,score] = predict(tree1,X(1:10)); [score X(1:10,:)]

ans = 10×3

0.9059 0.0941 0.8147

0.9059 0.0941 0.9058

0 1.0000 0.1270

0.9059 0.0941 0.9134

0.9059 0.0941 0.6324

0 1.0000 0.0975

0.9059 0.0941 0.2785

0.9059 0.0941 0.5469

0.9059 0.0941 0.9575

0.9059 0.0941 0.9649

Действительно, каждое значение X (крайний правый столбец), который меньше 0.15, сопоставил баллы (левые и центральные столбцы) 0 и 1, в то время как другие значения X сопоставили множество 0.91 и 0.09. Различие (выигрывают 0.09 вместо ожидаемого .06) происходит из-за статистического колебания: существует 8 наблюдения в X в области значений (.95,1) вместо ожидаемого 5 наблюдения.

Указания и ограничения по применению:

Только один выход поддерживается.

Можно использовать модели, обученные или на или на высоких данных в оперативной памяти с этой функцией.

Для получения дополнительной информации см. Раздел "Высокие массивы".

У вас есть модифицированная версия этого примера. Вы хотите открыть этот пример со своими редактированиями?

1. Если смысл перевода понятен, то лучше оставьте как есть и не придирайтесь к словам, синонимам и тому подобному. О вкусах не спорим.

2. Не дополняйте перевод комментариями “от себя”. В исправлении не должно появляться дополнительных смыслов и комментариев, отсутствующих в оригинале. Такие правки не получится интегрировать в алгоритме автоматического перевода.

3. Сохраняйте структуру оригинального текста - например, не разбивайте одно предложение на два.

4. Не имеет смысла однотипное исправление перевода какого-то термина во всех предложениях. Исправляйте только в одном месте. Когда Вашу правку одобрят, это исправление будет алгоритмически распространено и на другие части документации.

5. По иным вопросам, например если надо исправить заблокированное для перевода слово, обратитесь к редакторам через форму технической поддержки.