Обнаружение наличия речи в звуковом сигнале

voiceActivityDetector Система object™ обнаруживает наличие речи в аудиосегменте. Вы также можете использовать voiceActivityDetector Объект системы для вывода оценки дисперсии шума на частотный блок.

Для обнаружения наличия речи:

Создать voiceActivityDetector и задайте его свойства.

Вызовите объект с аргументами, как если бы это была функция.

Дополнительные сведения о работе системных объектов см. в разделе Что такое системные объекты?.

VAD = voiceActivityDetector создает объект System, VAD, которая определяет наличие речи независимо по каждому входному каналу.

VAD = voiceActivityDetector( задает каждое свойство Name,Value)Name к указанному Value. Неопределенные свойства имеют значения по умолчанию.

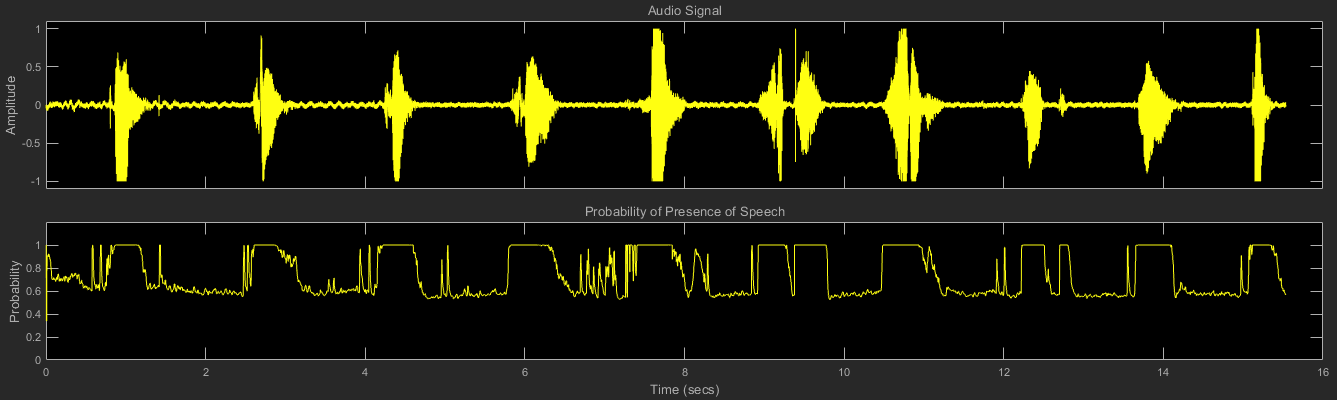

VAD = voiceActivityDetector('InputDomain','Frequency') создает объект System, VAD, который принимает вход в частотной области.[ применяет на входе детектор речевой активности, probability,noiseEstimate] = VAD(audioIn)audioInи возвращает вероятность присутствия речи. Он также возвращает оцененную дисперсию шума на частотный блок.

Чтобы использовать функцию объекта, укажите объект System в качестве первого входного аргумента. Например, для освобождения системных ресурсов объекта System с именем obj, используйте следующий синтаксис:

release(obj)

voiceActivityDetector реализует алгоритм, описанный в [1].

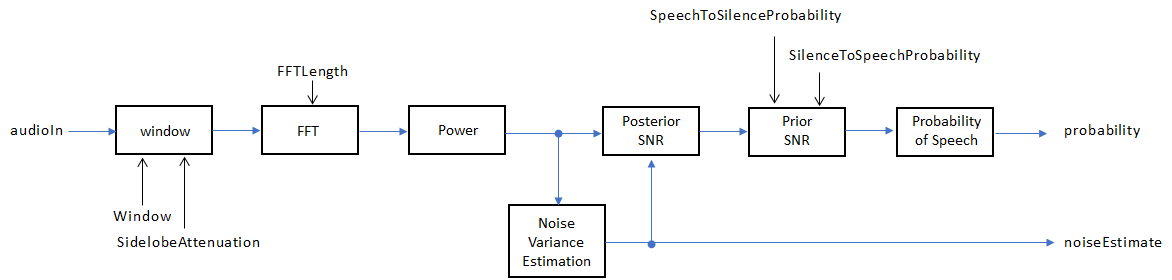

Если InputDomain указывается как 'Time', входной сигнал отображается в окне и затем преобразуется в частотную область в соответствии с Window, SidelobeAttenuation, и FFTLength свойства. Если InputDomain задают как частоту, вход принимают в виде оконного дискретного временного преобразования Фурье (DTFT) звукового сигнала. Затем сигнал преобразуется в область питания. Дисперсия шума оценивается согласно [2]. Задняя и предыдущая SNR оцениваются по формуле минимальной среднеквадратической ошибки (MMSE), описанной в [3]. Логарифмический тест отношения правдоподобия и схема зависания на основе скрытой марковской модели (HMM) определяют вероятность того, что текущий кадр содержит речь, согласно [1].

[1] Сон, Джонгсео, Нам Су Ким и Вонён Сен. «Обнаружение голосовой активности на основе статистической модели». Обработка сигналов письма IEEE. Том 6, № 1, 1999.

[2] Мартин, Р. «Оценка спектральной плотности мощности шума на основе оптимального сглаживания и минимальной статистики». Транзакции IEEE по обработке речи и звука. Том 9, № 5, 2001, стр. 504-512.

[3] Ефрем, Я. и Д. Мала. «Улучшение речи с использованием устройства оценки минимальной среднеквадратической ошибки с короткими временными спектральными амплитудами». Транзакции IEEE для обработки акустики, речи и сигналов. т. 32, № 6, 1984, с. 1109-1121.

audioFeatureExtractor | cepstralFeatureExtractor | mfcc | pitch | Детектор речевой активности