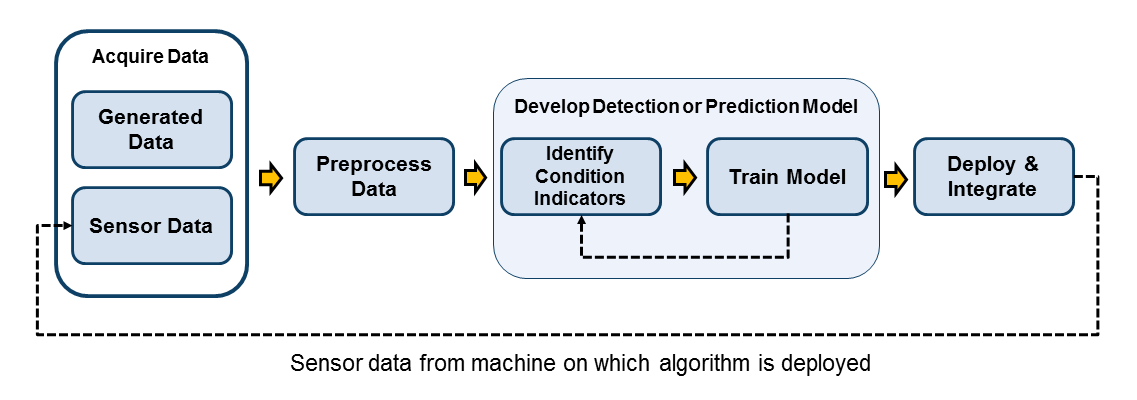

Мониторинг состояния включает различение между дефектными и здоровыми состояниями (fault detection) или, когда состояние отказа присутствует, определяя источник отказа (fault diagnosis). Чтобы спроектировать алгоритм для мониторинга состояния, вы используете индикаторы состояния, извлеченные из системных данных, чтобы обучить модель выбора решения, которая может анализировать индикаторы, извлеченные из тестовых данных, чтобы определить состояние существующей системы. Таким образом этот шаг в процессе проектирования алгоритма является следующим шагом после идентификации индикаторов состояния.

(Для получения информации об использовании индикаторов состояния для предсказания отказа см. Модели для Предсказания Остающегося Срока полезного использования.)

Некоторые примеры моделей выбора решения для мониторинга состояния включают:

Пороговое значение или набор границ на значении индикатора состояния, которое указывает на отказ, когда индикатор превышает его

Вероятностное распределение, которое описывает вероятность, что какое-то конкретное значение индикатора состояния показательно из какого-то конкретного типа отказа

Классификатор, который сравнивает текущее значение индикатора состояния к значениям, сопоставленным с состояниями отказа, и возвращает вероятность, которая один или другое состояние отказа присутствует

В общем случае, когда вы тестируете различные модели на обнаружение отказа или диагноз, вы создаете таблицу значений одного или нескольких индикаторов состояния. Индикаторы состояния являются функциями, которые вы извлекаете из данных в ансамбле, представляющем различные здоровые и дефектные условия работы. (См. Индикаторы состояния для Контроля, Обнаружения Отказа и Предсказания.) Полезно разделить ваши данные в подмножество, что вы используете для обучения модель выбора решения (training data) и непересекающееся подмножество, которое вы используете для валидации (validation data). По сравнению с обучением и валидацией с наложением наборов данных, с помощью абсолютно отдельных данных об обучении и валидации обычно дает вам лучший смысл того, как модель выбора решения выполнит с новыми данными.

При разработке алгоритма вы можете протестировать различное обнаружение отказа и модели диагноза с помощью различных индикаторов состояния. Таким образом этот шаг в процессе проектирования является, вероятно, итеративным с шагом извлечения индикаторов состояния, когда вы пробуете различные индикаторы, различные комбинации индикаторов и различные модели выбора решения.

Statistics and Machine Learning Toolbox™ и другие тулбоксы включают функциональность, которую можно использовать, чтобы обучить модели выбора решения, такие как модели регрессии и классификаторы. Некоторые общие подходы получены в итоге здесь.

Методы Feature selection помогают вам уменьшать большие наборы данных путем устранения функций, которые не важны анализу, который вы пытаетесь выполнить. В контексте мониторинга состояния несоответствующие функции - те, которые не отделяются здоровый от дефектной операции, или справка различают различные состояния отказа. Другими словами, выбор признаков означает идентифицировать те функции, которые подходят, чтобы служить индикаторами состояния, потому что они изменяются обнаруживаемым, надежным способом, когда производительность системы ухудшается. Некоторые функции для выбора признаков включают:

pca — Выполните principal component analysis, который находит линейную комбинацию независимых переменных данных, которые составляют самое большое изменение наблюдаемых величин. Например, предположите, что у вас есть десять независимых сигналов датчика для каждого члена вашего ансамбля, из которого вы извлекаете много функций. В этом случае анализ главных компонентов может помочь вам определить, какие функции или комбинация функций являются самыми эффективными для разделения различных здоровых и дефектных условий, представленных в вашем ансамбле. Прогнозирование высокоскоростного подшипника ветрогенератора в качестве примера использует этот подход к выбору признаков.

sequentialfs — Для набора функций кандидата идентифицируйте функции, которые лучше всего различают здоровые и дефектные условия путем последовательного выбора функций, пока нет никакого улучшения дискриминации.

fscnca — Выполните выбор признаков для классификации с помощью анализа компонента окружения. Пример Используя Simulink, чтобы Сгенерировать Данные об Отказе использует эту функцию, чтобы взвесить список извлеченных индикаторов состояния согласно их важности в различении среди условий отказа.

Для большего количества функций, относящихся к выбору признаков, смотрите Сокращение Размерности и Извлечение признаков.

Когда у вас есть таблица значений индикатора состояния и соответствующих состояний отказа, можно соответствовать значениям к статистическому распределению. Сравнение валидации или тестовых данных к получившемуся распределению дает к вероятности, что валидация или тестовые данные соответствуют один или другие состояния отказа. Некоторые функции, которые можно использовать для такого подбора кривой, включают:

ksdensity — Оцените плотность вероятности для выборочных данных.

histfit — Сгенерируйте гистограмму из данных и соответствуйте им к нормальному распределению. Диагностика отказа в качестве примера Центробежных Насосов Используя Эксперименты Устойчивого состояния использует этот подход.

ztest — Протестируйте вероятность, что данные прибывают из нормального распределения с заданным средним и стандартным отклонением.

Для получения дополнительной информации о статистических распределениях, смотрите Вероятностные распределения.

Существует несколько способов применить методы машинного обучения к проблеме обнаружения отказа и диагноза. Классификация является типом машинного обучения с учителем, на которое алгоритм “учится” классифицировать новые наблюдения из примеров маркированных данных. В контексте обнаружения отказа и диагноза, можно передать индикаторы состояния, выведенные из ансамбля и их соответствующих меток отказа к соответствующей алгоритму функции, которая обучает классификатор.

Например, предположите, что вы вычисляете таблицу значений индикатора состояния для каждого члена в ансамбле данных, которые охватывают различные здоровые и дефектные условия. Можно передать эти данные функции, которая подбирает модель классификатора. Этот training data обучает модель классификатора брать набор значений индикатора состояния, извлеченных из нового набора данных и предположения, какое здоровое или дефектное условие применяется к данным. На практике вы используете фрагмент своего ансамбля для обучения и резервируете непересекающийся фрагмент ансамбля для проверки обученного классификатора.

Statistics and Machine Learning Toolbox включает много функций, которые можно использовать, чтобы обучить классификаторы. Эти функции включают:

fitcsvm — Обучите бинарную модель классификации различать два состояния, такие как присутствие или отсутствие условия отказа. Примеры Используя Simulink, чтобы Сгенерировать Данные об Отказе используют эту функцию, чтобы обучить классификатор с таблицей основанных на функции индикаторов состояния. Диагностика отказа в качестве примера Центробежных Насосов Используя Эксперименты Устойчивого состояния также использует эту функцию с основанными на модели индикаторами состояния, вычисленными из статистических свойств параметров, полученных подходящими данными к статической модели.

fitcecoc — Обучите классификатор различать несколько состояний. Эта функция уменьшает многоклассовую задачу классификации до набора бинарных классификаторов. Мультиклассовое обнаружение неисправностей с использованием смоделированных данных в качестве примера использует эту функцию.

fitctree — Обучите модель классификации мультиклассов путем сокращения проблемы до набора деревьев выбора из двух альтернатив.

fitclinear — Обучите классификатор с помощью высоко-размерных обучающих данных. Эта функция может быть полезной, когда у вас есть большое количество индикаторов состояния, что вы не можете уменьшать функции использования такой как fscnca.

Другие методы машинного обучения включают k-means clustering (kmeans), который данные о разделах во взаимоисключающие кластеры. В этом методе новое измерение присвоено кластеру путем минимизации расстояния от точки данных до среднего местоположения ее присвоенного кластера. Древовидное укладывание в мешки является другим методом, который агрегировал ансамбль деревьев решений для классификации. Диагностика отказа в качестве примера Центробежных Насосов Используя Эксперименты Устойчивого состояния использует a TreeBagger классификатор.

Для более общей информации о методах машинного обучения для классификации смотрите Классификацию.

Другой подход к обнаружению отказа и диагнозу должен использовать идентификацию модели. В этом подходе вы оцениваете динамические модели работы системы в здоровых и дефектных состояниях. Затем вы анализируете, какая модель, более вероятно, объяснит живые измерения от системы. Этот подход полезен, когда у вас есть некоторая информация о вашей системе, которая может помочь вам выбрать тип модели для идентификации. Использовать этот подход, вас:

Соберите или симулируйте данные из системы, действующей в здоровом условии и в известном, дефектном, ухудшенном или условиях конца жизненного цикла.

Идентифицируйте динамическую модель, представляющую поведение в каждом здоровом условии и условии отказа.

Используйте кластеризирующиеся методы, чтобы чертить ясное различие между условиями.

Соберите новые данные от машины в операции и идентифицируйте модель ее поведения. Можно затем определить, какую из других моделей, здоровых или дефектных, скорее всего, объяснит наблюдаемое поведение.

Обнаружение Отказа в качестве примера Используя основанные на данных Модели использует этот подход. Функции, которые можно использовать для идентификации динамических моделей, включают:

Можно использовать функции как forecast предсказать будущее поведение идентифицированной модели.

Методы статистического управления процессами (SPC) являются методами для контроля и оценки качества промышленных товаров. SPC используется в программах, которые задают, измеряют, анализируют, улучшают и управляют процессами разработки и производства. В контексте прогнозирующего обслуживания диаграммы управления и правила управления могут помочь вам определить, когда значение индикатора состояния указывает на отказ. Например, предположите, что у вас есть индикатор состояния, который указывает на отказ, если это превышает порог, но также и показывает некоторое нормальное изменение, которое мешает идентифицировать, когда порог пересечен. Можно использовать правила управления, чтобы задать пороговое условие как появление, когда конкретное количество последовательных измерений превышает порог, а не всего один.

controlchart — Визуализируйте диаграмму управления.

controlrules — Задайте правила управления и определите, нарушены ли они.

cusum — Обнаружьте небольшие изменения в среднем значении данных.

Для получения дополнительной информации о статистическом управлении процессами, смотрите Статистическое управление процессами.

Другой способ обнаружить условия отказа состоит в том, чтобы отследить значение индикатора состояния в зависимости от времени и обнаружить резкие изменения в поведении тренда. Такие резкие изменения могут быть показательными из отказа. Некоторые функции, которые можно использовать для такого обнаружения точек изменения, включают:

findchangepts — Найдите резкие изменения в сигнале.

findpeaks — Найдите peaks в сигнале.

pdist, pdist2, mahal — Найдите расстояние между измерениями или наборами измерений, согласно различным определениям расстояния.

segment — Данные о сегменте и оценочный AR, ARX, ARMA или модели ARMAX для каждого сегмента. Обнаружение Отказа в качестве примера Используя основанные на данных Модели использует этот подход.