Обнаружение наличия речи в аудиосигнале

The voiceActivityDetector Системная object™ определяет наличие речи в аудиосегменте. Можно также использовать voiceActivityDetector Системный объект для вывода оценки отклонения шума на частотный интервал.

Чтобы обнаружить наличие речи:

Создайте voiceActivityDetector Объекту и установите его свойства.

Вызывайте объект с аргументами, как будто это функция.

Дополнительные сведения о работе системных объектов см. в разделе «Что такое системные объекты?».

VAD = voiceActivityDetector создает Системный объект, VAD, который обнаруживает присутствие речи независимо по каждому входному каналу.

VAD = voiceActivityDetector( устанавливает каждое свойство Name,Value)Name к заданной Value. Неопределенные свойства имеют значения по умолчанию.

VAD = voiceActivityDetector('InputDomain','Frequency') создает Системный объект, VAD, который принимает вход частотного диапазона.[ применяет на входе детектор голосовой активности, probability,noiseEstimate]

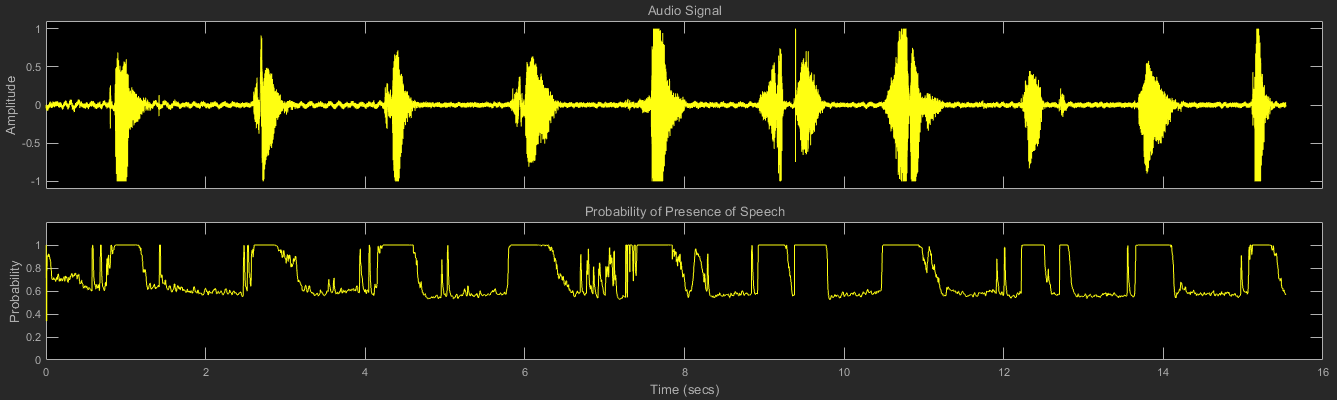

= VAD(audioIn)audioIn, и возвращает вероятность того, что речь присутствует. Это также возвращает предполагаемое отклонение шума на интервал частоты.

Чтобы использовать функцию объекта, задайте системный объект в качестве первого входного параметра. Например, чтобы освободить системные ресурсы системного объекта с именем obj, используйте следующий синтаксис:

release(obj)

The voiceActivityDetector реализует алгоритм, описанный в [1].

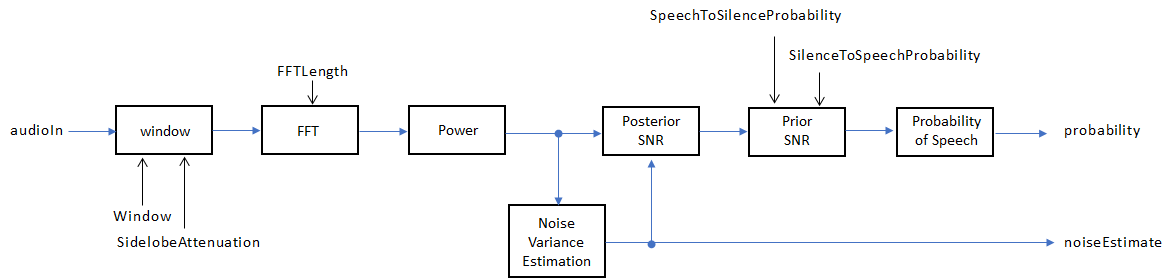

Если InputDomain задается как 'Time'входной сигнал окончается и затем преобразуется в частотный диапазон согласно Window, SidelobeAttenuation, и FFTLength свойства. Если InputDomain задан как частота, вход принят в виде оконного дискретного времени Фурье (DTFT) аудиосигнала. Затем сигнал преобразуется в область степени. Отклонение шума оценивается согласно [2]. Апостериорный и предшествующий ОСШ оцениваются согласно формуле минимальной среднеквадратичной ошибки (MMSE), описанной в [3]. Тест журнала коэффициента правдоподобия и основанная на скрытой модели Маркова (HMM) схема зависания определяют вероятность того, что текущая система координат содержит речь, согласно [1].

[1] Сон, Джонсео., Нам Су Ким и Вонён Сон. «Обнаружение голосовой активности на основе статистической модели». Обработка сигналов Букв IEEE. Том 6, № 1, 1999.

[2] Мартин, Р. «Оценка шумовой Степени спектральной плотности на основе оптимального сглаживания и минимальной статистики». Транзакции IEEE по обработке речи и аудио. Том 9, № 5, 2001, стр. 504-512.

[3] Ефрем, Я. и Д. Малах. «Улучшение речи с использованием оценки минимальной среднеквадратичной ошибки короткого времени спектральной амплитуды». Транзакции IEEE по акустике, речи и обработке сигналов. Том 32, № 6, 1984, стр. 1109-1121.

audioFeatureExtractor | cepstralFeatureExtractor | mfcc | pitch | Voice Activity Detector