Выполните выбор переменной прогноза для Байесовых моделей линейной регрессии

Чтобы оценить апостериорное распределение стандартной Байесовой модели линейной регрессии, смотрите estimate.

PosteriorMdl = estimate(PriorMdl,X,y)PosteriorMdl = estimate(PriorMdl,X,y,Name,Value)[PosteriorMdl,Summary]

= estimate(___)PosteriorMdl = estimate(PriorMdl,X,y)estimate также выполняет выбор переменной прогноза.

PriorMdl задает объединенное предшествующее распределение параметров, структуру модели линейной регрессии и алгоритма выбора переменной. X является данными о предикторе, и y является данными об ответе. PriorMdl и PosteriorMdl не являются тем же типом объекта.

Чтобы произвести PosteriorMdl, estimate обновляет предшествующее распределение с информацией о параметрах, которые это получает из данных.

NaN s в данных указывает на отсутствующие значения, которые estimate удаляет использующее мудрое списком удаление.

PosteriorMdl = estimate(PriorMdl,X,y,Name,Value)'Lambda',0.5 указывает, что значением параметров уменьшения для Байесовой регрессии лассо является 0.5 для всех коэффициентов кроме прерывания.

Если вы задаете Beta или Sigma2, то PosteriorMdl и PriorMdl равны.

[ использование любая из комбинаций входных аргументов в предыдущих синтаксисах и также возвращает таблицу, которая включает следующее для каждого параметра: следующие оценки, стандартные погрешности, 95%-е вероятные интервалы и апостериорная вероятность, что параметр больше, чем 0.PosteriorMdl,Summary]

= estimate(___)

Считайте несколько моделью линейной регрессии, которая предсказывает США действительный валовой национальный продукт (GNPR) с помощью линейной комбинации индекса промышленного производства (IPI), общая занятость (E) и действительная заработная плата (WR).

\forall , серия независимых Гауссовых воздействий со средним значением 0 и отклонение .

Примите, что предшествующие дистрибутивы:

Для k = 0..., 3, имеет распределение Лапласа со средним значением 0 и шкалой , где параметр уменьшения. Коэффициенты условно независимы.

. и форма и шкала, соответственно, обратного гамма распределения.

Создайте предшествующую модель для Байесовой регрессии лассо. Задайте количество предикторов, предшествующего типа модели и имен переменных. Задайте эти уменьшения:

0.01 для прерывания

10 для IPI и WR

1e5 для E, потому что это имеет шкалу, которая является несколькими порядками величины, больше, чем другие переменные

Порядок уменьшений выполняет приказ заданных имен переменных, но первый элемент является уменьшением прерывания.

p = 3; PriorMdl = bayeslm(p,'ModelType','lasso','Lambda',[0.01; 10; 1e5; 10],... 'VarNames',["IPI" "E" "WR"]);

PriorMdl является lassoblm Байесов объект модели линейной регрессии, представляющий предшествующее распределение отклонения воздействия и коэффициентов регрессии.

Загрузите набор данных Нельсона-Плоссера. Создайте переменные для ряда предиктора и ответа.

load Data_NelsonPlosser X = DataTable{:,PriorMdl.VarNames(2:end)}; y = DataTable{:,"GNPR"};

Выполните Байесовую регрессию лассо путем передачи предшествующей модели и данных к estimate, то есть, путем оценки апостериорного распределения и . Байесова регрессия лассо использует Цепь Маркова Монте-Карло (MCMC) для выборки от следующего. Для воспроизводимости, набор случайный seed.

rng(1); PosteriorMdl = estimate(PriorMdl,X,y);

Method: lasso MCMC sampling with 10000 draws

Number of observations: 62

Number of predictors: 4

| Mean Std CI95 Positive Distribution

-------------------------------------------------------------------------

Intercept | -1.3472 6.8160 [-15.169, 11.590] 0.427 Empirical

IPI | 4.4755 0.1646 [ 4.157, 4.799] 1.000 Empirical

E | 0.0001 0.0002 [-0.000, 0.000] 0.796 Empirical

WR | 3.1610 0.3136 [ 2.538, 3.760] 1.000 Empirical

Sigma2 | 60.1452 11.1180 [42.319, 85.085] 1.000 Empirical

PosteriorMdl является объектом модели empiricalblm, который хранилища чертит от апостериорных распределений и учитывая данные. estimate отображает сводные данные крайних апостериорных распределений в командной строке MATLAB®. Строки сводных данных соответствуют коэффициентам регрессии и отклонению воздействия, и столбцы соответствуют характеристикам апостериорного распределения. Характеристики включают:

CI95, который содержит 95%-е Байесовы equitailed вероятные интервалы для параметров. Например, апостериорная вероятность, что коэффициент регрессии IPI находится в [4.157, 4.799], 0.95.

Positive, который содержит апостериорную вероятность, что параметр больше, чем 0. Например, вероятностью, что прерывание больше, чем 0, является 0.427.

Постройте апостериорные распределения.

plot(PosteriorMdl)

Учитывая уменьшения, распределение E является довольно плотным приблизительно 0. Поэтому E не может быть важным предиктором.

По умолчанию estimate чертит и отбрасывает выборку выжигания дефектов размера 5000. Однако хорошая практика должна осмотреть график трассировки ничьих для соответствующего смешивания и отсутствия быстротечности. Постройте график трассировки ничьих для каждого параметра. Можно получить доступ к ничьим, которые составляют распределение (свойства BetaDraws и Sigma2Draws) использующий запись через точку.

figure; for j = 1:(p + 1) subplot(2,2,j); plot(PosteriorMdl.BetaDraws(j,:)); title(sprintf('%s',PosteriorMdl.VarNames{j})); end

figure;

plot(PosteriorMdl.Sigma2Draws);

title('Sigma2');

Графики трассировки показывают, что ничьи, кажется, смешиваются хорошо. Графики не показывают обнаруживаемой быстротечности или последовательной корреляции, и ничьи не переходят между состояниями.

Полагайте, что модель регрессии в Выбирает Variables Using Bayesian Lasso Regression.

Создайте предшествующую модель для выполнения стохастического поискового выбора переменной (SSVS). AssumeThat и зависят (сопряженная модель смеси). Задайте количество предикторов p и имена коэффициентов регрессии.

p = 3; PriorMdl = mixconjugateblm(p,'VarNames',["IPI" "E" "WR"]);

Загрузите набор данных Нельсона-Плоссера. Создайте переменные для ряда предиктора и ответа.

load Data_NelsonPlosser X = DataTable{:,PriorMdl.VarNames(2:end)}; y = DataTable{:,'GNPR'};

Реализуйте SSVS путем оценки крайних апостериорных распределений и . Поскольку SSVS использует Цепь Маркова Монте-Карло для оценки, установите seed случайных чисел воспроизводить результаты.

rng(1); PosteriorMdl = estimate(PriorMdl,X,y);

Method: MCMC sampling with 10000 draws

Number of observations: 62

Number of predictors: 4

| Mean Std CI95 Positive Distribution Regime

----------------------------------------------------------------------------------

Intercept | -18.8333 10.1851 [-36.965, 0.716] 0.037 Empirical 0.8806

IPI | 4.4554 0.1543 [ 4.165, 4.764] 1.000 Empirical 0.4545

E | 0.0010 0.0004 [ 0.000, 0.002] 0.997 Empirical 0.0925

WR | 2.4686 0.3615 [ 1.766, 3.197] 1.000 Empirical 0.1734

Sigma2 | 47.7557 8.6551 [33.858, 66.875] 1.000 Empirical NaN

PosteriorMdl является объектом модели empiricalblm, который хранилища чертит от апостериорных распределений и учитывая данные. estimate отображает сводные данные крайних апостериорных распределений в командной строке. Строки сводных данных соответствуют коэффициентам регрессии и отклонению воздействия, и столбцы соответствуют характеристикам апостериорного распределения. Характеристики включают:

CI95, который содержит 95%-е Байесовы equitailed вероятные интервалы для параметров. Например, апостериорная вероятность, что коэффициент регрессии (стандартизированного) E находится в [0.000, 0.0.002], 0.95.

Regime, который содержит крайнюю апостериорную вероятность переменного включения ( для переменной). Например, апостериорная вероятность E, который должен быть включен в модель, 0.0925.

Предположение, что переменные с Regime <0.1 должны быть удалены из модели, результаты предполагают, что можно исключить уровень безработицы из модели.

По умолчанию estimate чертит и отбрасывает выборку выжигания дефектов размера 5000. Однако хорошая практика должна осмотреть график трассировки ничьих для соответствующего смешивания и отсутствия быстротечности. Постройте график трассировки ничьих для каждого параметра. Можно получить доступ к ничьим, которые составляют распределение (свойства BetaDraws и Sigma2Draws) использующий запись через точку.

figure; for j = 1:(p + 1) subplot(2,2,j); plot(PosteriorMdl.BetaDraws(j,:)); title(sprintf('%s',PosteriorMdl.VarNames{j})); end

figure;

plot(PosteriorMdl.Sigma2Draws);

title('Sigma2');

Графики трассировки показывают, что ничьи, кажется, смешиваются хорошо. Графики не показывают обнаруживаемой быстротечности или последовательной корреляции, и ничьи не переходят между состояниями.

Рассмотрите регрессию, образцовое и предшествующее распределение в Выбирает Variables Using Bayesian Lasso Regression.

Создайте Байесовую регрессию лассо предшествующая модель для 3 предикторов и задайте имена переменных. Задайте значения уменьшения 0.01, 10, 1e5, и 10 для прерывания и коэффициенты IPI, E и WR.

p = 3; PriorMdl = bayeslm(p,'ModelType','lasso','VarNames',["IPI" "E" "WR"],... 'Lambda',[0.01; 10; 1e5; 10]);

Загрузите набор данных Нельсона-Плоссера. Создайте переменные для ряда предиктора и ответа.

load Data_NelsonPlosser X = DataTable{:,PriorMdl.VarNames(2:end)}; y = DataTable{:,"GNPR"};

Оцените условные апостериорные распределения учитывая данные и это . Возвратите сводную таблицу оценки.

rng(1); % For reproducibility [Mdl,SummaryBeta] = estimate(PriorMdl,X,y,'Sigma2',10);

Method: lasso MCMC sampling with 10000 draws

Conditional variable: Sigma2 fixed at 10

Number of observations: 62

Number of predictors: 4

| Mean Std CI95 Positive Distribution

------------------------------------------------------------------------

Intercept | -8.0643 4.1992 [-16.384, 0.018] 0.025 Empirical

IPI | 4.4454 0.0679 [ 4.312, 4.578] 1.000 Empirical

E | 0.0004 0.0002 [ 0.000, 0.001] 0.999 Empirical

WR | 2.9792 0.1672 [ 2.651, 3.305] 1.000 Empirical

Sigma2 | 10 0 [10.000, 10.000] 1.000 Empirical

estimate отображает сводные данные условного апостериорного распределения . Поскольку фиксируется во время оценки, выводы на ней тривиальны.

Отобразите Mdl.

Mdl

Mdl =

lassoblm with properties:

NumPredictors: 3

Intercept: 1

VarNames: {4x1 cell}

Lambda: [4x1 double]

A: 3

B: 1

| Mean Std CI95 Positive Distribution

---------------------------------------------------------------------------

Intercept | 0 100 [-200.000, 200.000] 0.500 Scale mixture

IPI | 0 0.1000 [-0.200, 0.200] 0.500 Scale mixture

E | 0 0.0000 [-0.000, 0.000] 0.500 Scale mixture

WR | 0 0.1000 [-0.200, 0.200] 0.500 Scale mixture

Sigma2 | 0.5000 0.5000 [ 0.138, 1.616] 1.000 IG(3.00, 1)

Поскольку estimate вычисляет условное апостериорное распределение, он возвращает образцовый вход PriorMdl, не следующее условное выражение, в первом положении списка выходных аргументов.

Отобразите сводную таблицу оценки.

SummaryBeta

SummaryBeta=5×6 table

Mean Std CI95 Positive Distribution Covariances

__________ __________ ________________________ ________ ____________ _______________________________________________________________________

Intercept -8.0643 4.1992 -16.384 0.01837 0.0254 'Empirical' 17.633 0.17621 -0.00053724 0.11705 0

IPI 4.4454 0.067949 4.312 4.5783 1 'Empirical' 0.17621 0.0046171 -1.4103e-06 -0.0068855 0

E 0.00039896 0.00015673 9.4925e-05 0.00070697 0.9987 'Empirical' -0.00053724 -1.4103e-06 2.4564e-08 -1.8168e-05 0

WR 2.9792 0.16716 2.6506 3.3046 1 'Empirical' 0.11705 -0.0068855 -1.8168e-05 0.027943 0

Sigma2 10 0 10 10 1 'Empirical' 0 0 0 0 0

SummaryBeta содержит условные следующие оценки.

Оцените условные апостериорные распределения учитывая, что условное следующее среднее значение (сохраненный в SummaryBeta.Mean(1:(end – 1))). Возвратите сводную таблицу оценки.

condPostMeanBeta = SummaryBeta.Mean(1:(end - 1));

[~,SummarySigma2] = estimate(PriorMdl,X,y,'Beta',condPostMeanBeta);Method: lasso MCMC sampling with 10000 draws

Conditional variable: Beta fixed at -8.0643 4.4454 0.00039896 2.9792

Number of observations: 62

Number of predictors: 4

| Mean Std CI95 Positive Distribution

------------------------------------------------------------------------

Intercept | -8.0643 0.0000 [-8.064, -8.064] 0.000 Empirical

IPI | 4.4454 0.0000 [ 4.445, 4.445] 1.000 Empirical

E | 0.0004 0.0000 [ 0.000, 0.000] 1.000 Empirical

WR | 2.9792 0.0000 [ 2.979, 2.979] 1.000 Empirical

Sigma2 | 56.8314 10.2921 [39.947, 79.731] 1.000 Empirical

estimate отображает сводные данные оценки условного апостериорного распределения учитывая данные и это condPostMeanBeta. В отображении, выводах на тривиальны.

Полагайте, что модель регрессии в Выбирает Variables Using Bayesian Lasso Regression.

Создайте предшествующую модель для выполнения SSVS. AssumeThat и зависят (сопряженная модель смеси). Задайте количество предикторов p и имена коэффициентов регрессии.

p = 3; PriorMdl = mixconjugateblm(p,'VarNames',["IPI" "E" "WR"]);

Загрузите набор данных Нельсона-Плоссера. Создайте переменные для ряда предиктора и ответа.

load Data_NelsonPlosser X = DataTable{:,PriorMdl.VarNames(2:end)}; y = DataTable{:,'GNPR'};

Реализуйте SSVS путем оценки крайних апостериорных распределений и . Поскольку SSVS использует Цепь Маркова Монте-Карло для оценки, установите seed случайных чисел воспроизводить результаты. Подавите отображение оценки, но возвратите сводную таблицу оценки.

rng(1);

[PosteriorMdl,Summary] = estimate(PriorMdl,X,y,'Display',false);PosteriorMdl является объектом модели empiricalblm, который хранилища чертит от апостериорных распределений и учитывая данные. Summary является таблицей со столбцами, соответствующими следующим характеристикам и строкам, соответствующим коэффициентам (PosteriorMdl.VarNames) и отклонение воздействия (Sigma2).

Отобразите предполагаемую ковариационную матрицу параметра (Covariances) и пропорция времен, алгоритм включает каждый предиктор (Regime).

Covariances = Summary(:,"Covariances")Covariances=5×1 table

Covariances

______________________________________________________________________

Intercept 103.74 1.0486 -0.0031629 0.6791 7.3916

IPI 1.0486 0.023815 -1.3637e-05 -0.030387 0.06611

E -0.0031629 -1.3637e-05 1.3481e-07 -8.8792e-05 -0.00025044

WR 0.6791 -0.030387 -8.8792e-05 0.13066 0.089039

Sigma2 7.3916 0.06611 -0.00025044 0.089039 74.911

Regime = Summary(:,"Regime")Regime=5×1 table

Regime

______

Intercept 0.8806

IPI 0.4545

E 0.0925

WR 0.1734

Sigma2 NaN

Regime содержит крайнюю апостериорную вероятность переменного включения ( для переменной). Например, апостериорная вероятность, что E должен быть включен в модель, 0.0925.

Предположение, что переменные с Regime <0.1 должны быть удалены из модели, результаты предполагают, что можно исключить уровень безработицы из модели.

PriorMdl — Байесова модель линейной регрессии для выбора переменной прогнозаmixconjugateblm | объект модели mixsemiconjugateblm | объект модели lassoblmБайесова модель линейной регрессии для выбора переменной прогноза, заданного как объект модели в этой таблице.

| Объект модели | Описание |

|---|---|

mixconjugateblm | Зависимая, Гауссова гамма инверсии смеси спрягает модель для выбора переменной прогноза SSVS, возвращенного bayeslm |

mixsemiconjugateblm | Независимая, Гауссова гамма инверсии смеси полуспрягает модель для выбора переменной прогноза SSVS, возвращенного bayeslm |

lassoblm | Байесова модель регрессии лассо возвращена bayeslm |

X Данные о предиктореДанные о предикторе для нескольких модель линейной регрессии, заданная как numObservations-by-PriorMdl.NumPredictors числовая матрица. numObservations является количеством наблюдений и должен быть равен длине y.

Типы данных: double

y Данные об ответеДанные об ответе для нескольких модель линейной регрессии, заданная как числовой вектор с элементами numObservations.

Типы данных: double

Укажите необязательные аргументы в виде пар ""имя, значение"", разделенных запятыми. Имя (Name) — это имя аргумента, а значение (Value) — соответствующее значение. Name должен появиться в кавычках. Вы можете задать несколько аргументов в виде пар имен и значений в любом порядке, например: Name1, Value1, ..., NameN, ValueN.

'Sigma2',2 задает оценку условного апостериорного распределения коэффициентов регрессии, учитывая данные и что заданным отклонением воздействия является 2.Отображение Отметьте, чтобы отобразить Байесовы сводные данные средства оценки к командной строкеtrue (значение по умолчанию) | falseОтметьте, чтобы отобразить Байесовы сводные данные средства оценки к командной строке, заданной как пара, разделенная запятой, состоящая из 'Display' и значения в этой таблице.

| Значение | Описание |

|---|---|

true | estimate распечатывает информацию об оценке и таблицу, обобщающую Байесовы средства оценки к командной строке. |

false | estimate не распечатывает к командной строке. |

Информация об оценке включает метод оценки, зафиксированные параметры, количество наблюдений и количество предикторов. Сводная таблица содержит оцененные следующие средние значения, стандартные отклонения (квадратный корень из следующего отклонения), 95% equitailed вероятные интервалы, апостериорная вероятность, что параметр больше, чем 0, и описание апостериорного распределения (если известный). Для моделей, которые выполняют SSVS, таблица отображения включает столбец для вероятностей переменного включения.

Если вы задаете или Beta или Sigma2, то estimate включает вашу спецификацию в отображение. Соответствующие следующие оценки тривиальны.

Пример: 'Display',false

Типы данных: логический

\beta Значение коэффициентов регрессии для условной оценки апостериорного распределения отклонения воздействия[]) (значение по умолчанию) | числовой вектор-столбецЗначение коэффициентов регрессии для условной оценки апостериорного распределения отклонения воздействия, заданного как пара, разделенная запятой, состоящая из 'Beta' и (PriorMdl.Intercept + PriorMdl.NumPredictors)-by-1 числовой вектор. estimate оценивает характеристики π (σ 2|y, X, β = Beta), где y является y, X является X, и Beta является значением 'Beta'. Если PriorMdl.Intercept является true, то Beta(1) соответствует образцовому прерыванию. Все другие значения соответствуют переменным прогноза, которые составляют столбцы X. Beta не может содержать значения NaN (то есть, все коэффициенты должны быть известны).

Вы не можете задать Beta и Sigma2 одновременно.

По умолчанию estimate не вычисляет характеристики условного выражения, следующего из σ 2.

Пример: 'Beta',1:3

Типы данных: double

'Sigma2' — Значение отклонения воздействия для условной оценки апостериорного распределения коэффициентов регрессии[]) (значение по умолчанию) | положительный числовой скалярЗначение отклонения воздействия для условной оценки апостериорного распределения коэффициентов регрессии, заданных как пара, разделенная запятой, состоящая из 'Sigma2' и положительного числового скаляра. estimate оценивает характеристики π (β |y, X, Sigma2), где y является y, X является X, и Sigma2 является значением 'Sigma2'.

Вы не можете задать Sigma2 и Beta одновременно.

По умолчанию estimate не вычисляет характеристики условного выражения, следующего из β.

Пример: 'Sigma2',1

Типы данных: double

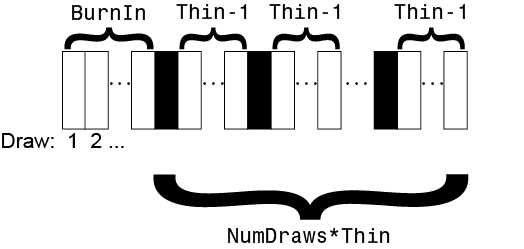

'NumDraws' — Симуляция Монте-Карло настроила объем выборки1e5 (значение по умолчанию) | положительное целое числоСимуляция Монте-Карло настроила объем выборки, заданный как пара, разделенная запятой, состоящая из 'NumDraws' и положительного целого числа. estimate на самом деле чертит BurnIn – выборки NumDraws* Thin. Поэтому estimate основывает оценки от выборок NumDraws. Для получения дополнительной информации о том, как estimate уменьшает полную выборку Монте-Карло, см. Алгоритмы.

Пример: 'NumDraws',1e7

Типы данных: double

'BurnIn' — Количество ничьих, чтобы удалить с начала выборки Монте-Карло5000 (значение по умолчанию) | неотрицательный скалярКоличество ничьих, чтобы удалить с начала выборки Монте-Карло уменьшать переходные эффекты, заданные как пара, разделенная запятой, состоящая из 'BurnIn' и неотрицательного скаляра. Для получения дополнительной информации о том, как estimate уменьшает полную выборку Монте-Карло, см. Алгоритмы.

Чтобы помочь вам задать соответствующий размер электротермотренировки, определите степень переходного поведения в выборке Монте-Карло путем определения 'BurnIn',0, симуляции нескольких тысяч наблюдений с помощью simulate, и затем строя пути.

Пример: 'BurnIn',0

Типы данных: double

'Thin' — Монте-Карло настроил множитель объема выборки1 (значение по умолчанию) | положительное целое числоМонте-Карло настроил множитель объема выборки, заданный как пара, разделенная запятой, состоящая из 'Thin' и положительного целого числа.

Фактическим объемом выборки Монте-Карло является BurnIn + NumDraws *Thin. После отбрасывания выжигания дефектов estimate отбрасывает каждый Thin – 1 чертит, и затем сохраняет следующее. Для получения дополнительной информации о том, как estimate уменьшает полную выборку Монте-Карло, см. Алгоритмы.

Чтобы уменьшать потенциальную большую последовательную корреляцию в выборке Монте-Карло или уменьшать потребление памяти ничьих, сохраненных в PosteriorMdl, задают большое значение для Thin.

Пример: 'Thin',5

Типы данных: double

'BetaStart' — Начальные значения коэффициентов регрессии для выборки MCMCНачальные значения коэффициентов регрессии для выборки Цепи Маркова Монте-Карло (MCMC), заданной как пара, разделенная запятой, состоящая из 'BetaStart' и числового вектор-столбца с (PriorMdl.Intercept + PriorMdl.NumPredictors) элементы. По умолчанию BetaStart является оценкой обычных наименьших квадратов (OLS).

Хорошая практика должна запустить estimate многократно с помощью различных начальных значений параметра. Проверьте, что решения от каждого выполнения сходятся к подобным значениям.

Пример: 'BetaStart',[1; 2; 3]

Типы данных: double

'Sigma2Start' — Начальные значения отклонения воздействия для выборки MCMCНачальные значения отклонения воздействия для выборки MCMC, заданной как пара, разделенная запятой, состоящая из 'Sigma2Start' и положительного числового скаляра. По умолчанию Sigma2Start является остаточной среднеквадратической ошибкой OLS.

Хорошая практика должна запустить estimate многократно с помощью различных начальных значений параметра. Проверьте, что решения от каждого выполнения сходятся к подобным значениям.

Пример: 'Sigma2Start',4

Типы данных: double

PosteriorMdl — Байесова модель линейной регрессии хранение характеристик распределенияmixconjugateblm | объект модели mixsemiconjugateblm | объект модели lassoblm | объект модели empiricalblmБайесова модель линейной регрессии хранение характеристик распределения, возвращенных как mixconjugateblm, mixsemiconjugateblm, lassoblm или объект модели empiricalblm.

Если вы не задаете или Beta или Sigma2 (их значениями является []), то estimate обновляет предшествующую модель с помощью вероятности данных, чтобы сформировать апостериорное распределение. PosteriorMdl характеризует апостериорное распределение и является объектом модели empiricalblm. Информационные хранилища PosteriorMdl или отображения помогают вам решить, важны ли переменные прогноза.

Если вы задаете или Beta или Sigma2, то PosteriorMdl равняется PriorMdl (эти две модели являются тем же объектом, хранящим те же значения свойств). estimate не обновляет предшествующую модель, чтобы сформировать следующую модель. Однако Summary хранит условные следующие оценки.

Для получения дополнительной информации на отображении PosteriorMdl, смотрите Summary.

Сводные данные Сводные данные Байесовых средств оценкиСводные данные Байесовых средств оценки, возвращенных как таблица. Summary содержит ту же информацию как отображение сводных данных оценки (Display). Строки соответствуют параметрам, и столбцы соответствуют этим следующим характеристикам:

Среднее значение Следующее среднее значение

Станд Следующее стандартное отклонение

CI95 – 95% equitailed вероятный интервал

Positive – Апостериорная вероятность, что параметр больше, чем 0

Distribution – Описание крайнего или условного апостериорного распределения параметра, когда известный

Covariances – Предполагаемая ковариационная матрица коэффициентов и отклонения воздействия

Regime – Вероятности переменного включения для моделей, которые выполняют SSVS; низкие вероятности указывают, что переменная должна быть исключена из модели

Имена строки являются именами в PriorMdl.VarNames. Именем последней строки является Sigma2.

Также передайте PosteriorMdl summarize, чтобы получить сводные данные Байесовых средств оценки.

Bayesian linear regression model обрабатывает параметры β и σ 2 в модели yt нескольких линейных регрессий (MLR) = xt β + εt как случайные переменные.

В течение многих времен t = 1..., T:

yt является наблюдаемым ответом.

xt является 1 на (p + 1) вектор - строка из наблюдаемых величин предикторов p. Размещать образцовое прерывание, x 1t = 1 для всего t.

β (p + 1)-by-1 вектор-столбец коэффициентов регрессии, соответствующих переменным, которые составляют столбцы xt.

εt является случайным воздействием со средним значением нуля и Cov (ε) = σ 2IT×T, в то время как ε является T-by-1 вектор, содержащий все воздействия. Эти предположения подразумевают, что вероятность данных

ϕ (yt; xtβ, σ 2) является Гауссовой плотностью вероятности со средним xtβ и отклонением σ 2 оцененных в yt;.

Прежде, чем рассмотреть данные, вы налагаете предположение joint prior distribution на (β, σ 2). В Байесовом анализе вы обновляете распределение параметров при помощи информации о параметрах, полученных из вероятности данных. Результатом является joint posterior distribution (β, σ 2) или conditional posterior distributions параметров.

Симуляция Монте-Карло подвергается изменению. Если estimate использует симуляцию Монте-Карло, то оценки и выводы могут отличаться, когда вы вызываете estimate многократно при на вид эквивалентных условиях. Чтобы воспроизвести результаты оценки, прежде, чем вызвать estimate, устанавливают seed случайных чисел при помощи rng.

Эти данные показывают, как estimate уменьшает выборку Монте-Карло использование значений NumDraws, Thin и BurnIn.

Прямоугольники представляют последовательные ничьи от распределения. estimate удаляет белые прямоугольники из выборки Монте-Карло. Остающийся NumDraws черные прямоугольники составляет выборку Монте-Карло.

1. Если смысл перевода понятен, то лучше оставьте как есть и не придирайтесь к словам, синонимам и тому подобному. О вкусах не спорим.

2. Не дополняйте перевод комментариями “от себя”. В исправлении не должно появляться дополнительных смыслов и комментариев, отсутствующих в оригинале. Такие правки не получится интегрировать в алгоритме автоматического перевода.

3. Сохраняйте структуру оригинального текста - например, не разбивайте одно предложение на два.

4. Не имеет смысла однотипное исправление перевода какого-то термина во всех предложениях. Исправляйте только в одном месте. Когда Вашу правку одобрят, это исправление будет алгоритмически распространено и на другие части документации.

5. По иным вопросам, например если надо исправить заблокированное для перевода слово, обратитесь к редакторам через форму технической поддержки.